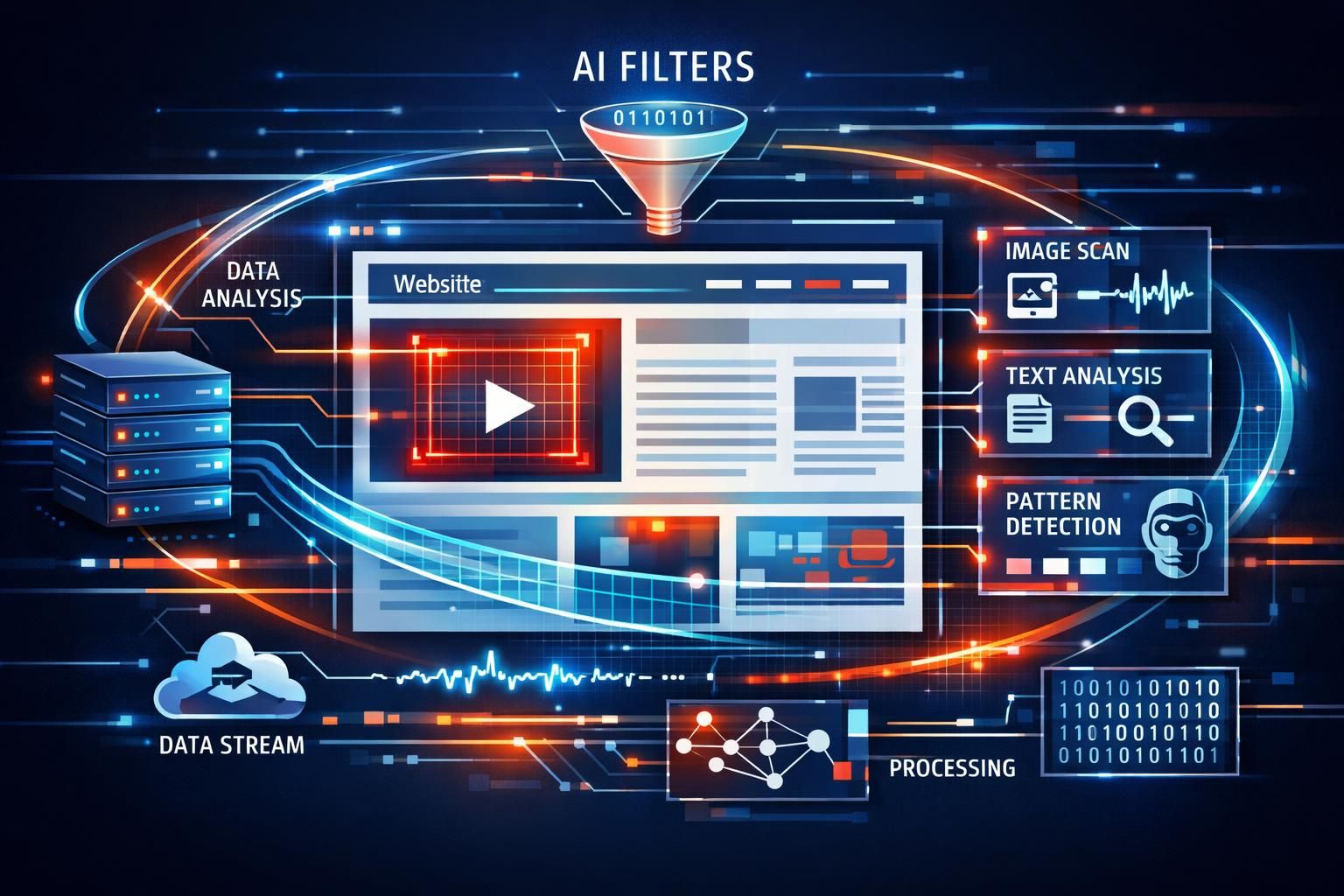

UnsichtbareInhalte sind 2026 für viele Unternehmen Realität: Während Webseiten in klassischen Suchmaschinen wie Google sichtbar bleiben, filtern immer mehr KI-Systeme Seiten bereits heraus, ehe ein klassisches Ranking entsteht. Betreiber sehen sich mit unterschiedlicher Datenfilterung und schnellen Inhaltsanalyse-Prozessen konfrontiert. Wer seine Präsenz nicht für diese neuen Zugangswege optimiert, bleibt für Nutzer von ChatGPT, Perplexity oder Claude faktisch unsichtbar.

Dieser Text erklärt, wie der aktuelle Algorithmus-Mix funktioniert, welche technischen Hürden beim Seitenfiltern auftreten und welche konkreten Schritte zur Webseitenoptimierung nötig sind.

Wie KI-Systeme Inhalte verstehen und auswählen

Generative Systeme greifen auf drei grundlegend unterschiedliche Quellen zurück: historisches Training, Live-Crawling und strukturierte APIs. Das beeinflusst, welche Seiten eine KünstlicheIntelligenz überhaupt kennt oder zitiert.

Training Data als historischer Rucksack

Viele Modelle besitzen einen Stichtag: ChatGPT‑4 wurde etwa bis April 2024 trainiert, Claude bis Januar 2025. Inhalte nach diesen Daten sind für das jeweilige Modell nicht im Trainingsbestand enthalten.

Das bedeutet: Ein neu positioniertes Unternehmen oder aktualisierte Produktseiten können in Antworten älterer Modelle weiterhin falsch dargestellt werden. Diese Fakten erklären, warum ältere, etablierte Inhalte bei manchen KI-Systemen bevorzugt werden.

Live‑Crawling und API‑Zugriffe

Systeme wie Perplexity oder ChatGPT mit Web‑Browsing starten bei Bedarf einen kurzen Crawl‑Prozess und integrieren aktuelle Inhalte in Sekunden. Andere KIs beziehen Daten gezielt über APIs von Wikipedia, News‑Feeds oder Fachportalen.

Der Unterschied: Live‑Crawler sind zeitkritisch und tolerant gegenüber JavaScript‑lastigen Seiten nur in geringem Maße, während API‑Zugriffe strukturierte Daten bevorzugen. Das erklärt, warum manche Seiten in der KI‑Antwort auftauchen und andere nicht.

Die Paginierungs-Falle und technische Hürden beim Seitenfiltern

Viele Webseiten verlieren Sichtbarkeit, weil sie für klassische Suchmaschinen optimiert sind, nicht für die schnelle Inhaltsanalyse von KI‑Crawlern. Schuld sind oft technische Entscheidungen wie Single‑Page‑Apps oder Infinite‑Scroll ohne HTML‑Fallback.

Technische Präferenzen der KI‑Crawler

KI‑Crawler bevorzugen serverseitig gerenderte HTML‑Seiten, schnelle Ladezeiten (erstes sichtbares Element unter 3 Sekunden) und klare Meta‑Informationen. Cookie‑Banner, Login‑Wände und langsame Server sind Ausschlussgründe.

Ein Beispiel aus der Praxis: Seiten, die auf clientseitiges Rendering setzen, liefern zwar Google‑Indexsignale, doch Live‑Crawler geben oft nach wenigen Sekunden Fehlversuchen auf. Das führt zu UnsichtbareInhalte in KI‑Antworten trotz guten Google‑Rankings.

Praktische Schritte für bessere Webseitenoptimierung gegenüber KI

Die gute Nachricht: Viele Optimierungen sind konkret und umsetzbar. Zentrale Maßnahmen betreffen Struktur, Metadaten und Erreichbarkeit.

Struktur und Metadaten gezielt verbessern

Nutzen Sie Schema.org‑Markup (JSON‑LD) für Artikel, Organisationen, Services und FAQ‑Strukturen, damit APIs und KI‑Indexer Inhalte maschinenlesbar finden. Sichtbare Publikationsdaten und Zuletzt aktualisiert-Angaben signalisieren Aktualität.

Optimierte Meta‑Descriptions geben KI‑Systemen Kontext; klare H2‑Fragestellungen mit präziser erster Antwort erhöhen die Chance, in einer KI‑Antwort zitiert zu werden.

Prüfen, messen, anpassen

Führen Sie einen kurzen Multi‑KI‑Test durch: Bitten Sie ChatGPT (Web‑Browsing), Perplexity und Bing Chat, eine Zielseite zusammenzufassen. Dokumentieren Sie, ob die Seite gefunden wird und ob Inhalte korrekt wiedergegeben sind.

Analyse‑Tools wie PageSpeed Insights, Google Rich Results Test und die Search Console zeigen, ob Ladezeit, strukturierte Daten und Crawl‑Zugänglichkeit passen. Diese Messungen sind die Basis jeder Webseitenoptimierung für KünstlicheIntelligenz.

Kernerkenntnis: Sichtbarkeit in klassischen Suchmaschinen ist heute nicht automatisch Sichtbarkeit für KI‑gestützte Antworten. Wer seine Inhalte für KI-Systeme optimiert, reduziert das Risiko, als UnsichtbareInhalte zu gelten und sichert Reichweite in neuen Antwortformaten.